Google tworzy AI, które ma „usprawnić” pracę dziennikarzy

Jak podaje New York Times, Google stara się przekonać do swojego dzieła reprezentantów największych tabloidów – Wall Street Journal, Washington Post i… New York Times. Na prezentacji, która odbyła się za zamkniętymi drzwiami, przedstawiciele giganta z Mountain View przedstawiali Genesis jako narzędzie, które potrafi wychwycić najważniejsze fakty z danego artykułu i na ich podstawie napisać newsa w wybranym stylu.

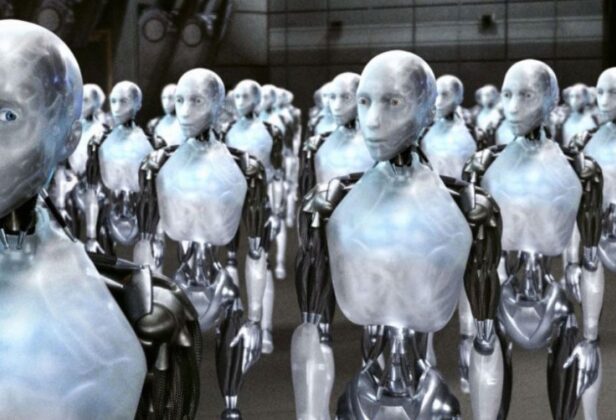

Redaktor przyszłości

Zdaniem jednej z osób, która była w stanie na własne oczy ujrzeć najnowszy twór Google w akcji, korporacja głęboko wierzy, a przynajmniej takie próbuje wywrzeć wrażenie, że Genesis jest w stanie pełnić funkcję osobistego asystenta dziennikarzy, który ułatwiłby ich pracę poprzez eliminację jej najbardziej żmudnych elementów oraz automatyzację innych. Zaznaczono przy tym, że owe AI jest niezwykle odpowiedzialne i pomogłoby branży wydawniczej uniknąć pułapek związanych z korzystaniem z innych modeli generatywnej sztucznej inteligencji.

Część z przedstawicieli wymienionych wcześniej dzienników uznała całą prezentację za dość niepokojącą i postanowili omówić kwestie z nią związane w zamkniętym gronie. Z kolei przedstawiciel News Corp., firmy stojącej za Wall Street Journal, przekazał, że jego firma ma świetne stosunki z Google i cieszy się z długoterminowego zaangażowania Sundara Pichaia w dziennikarstwo. Głos zabrała także Jenn Crider z Google, która postanowiła uspokoić wszelkie osoby niezadowolone z rzeczonego projektu korporacji.

Narzędzia te nie mają i nie mogą zastąpić zasadniczej roli dziennikarzy w raportowaniu, tworzeniu i sprawdzaniu faktów w swoich artykułach. Zamiast tego mogą one pomóc w pisaniu nagłówków oraz generowania tekstów w innych stylach pisania.

Na zagrożenia płynące z potencjalnego nadużywania Genesis uwagę zwrócił Jeff Jarvis, profesor dziennikarstwa:

Jeśli zostanie ono nadużywane przez dziennikarzy i organizacje informacyjne w tematach wymagających niuansów i zrozumienia kulturowego, może to zaszkodzić wiarygodności nie tylko narzędzia, ale także organizacji informacyjnych, które go używają.

Nie zmienia to także faktu, że owo AI może mieć także i swoje zalety, którym również poświęcił część swojej wypowiedzi:

Jeśli ta technologia może dostarczać wiarygodnych informacji, dziennikarze powinni z niej korzystać.

Pytanie tylko, czy informacje przekazywane przez sztuczną inteligencję powinny być automatycznie traktowane jako wiarygodne. Zarówno ChatGPT, Bing, jak i Bard udowodniły, że do wypluwanych przez nie rewelacji należy podchodzić ze sporą dozą sceptycyzmu i słusznym podejściem byłaby weryfikacja wszystkich otrzymywanych od nich odpowiedzi. To z kolei w pewnym stopniu zaprzecza idei istnienia narzędzia, które ma zredukować czas poświęcany na poszukiwanie prawdziwych wiadomości.

Warto przypomnieć, że czatbotowi ze stajni OpenAI zdarzyło się oskarżyć australijskiego polityka o korupcję, co średnio przypadło owemu jegomościowi do gustu i raczej trudno się temu dziwić. Wyobraźmy sobie teraz sytuację, gdy część z redakcji korzystających AI Google’a traktuje tę informację jako prawdziwą i na jej bazie powstaje szereg artykułów powielających paszkwil. Sprostowanie pomyłki na tak ogromną skalę graniczyłoby z cudem, a sztuczna inteligencja, nieświadoma skali zniszczeń, do których doprowadziła, ochoczo wypluwałaby z siebie kolejne rewelacje tego właśnie pokroju. Chociaż, jak twierdzi Google, „Genesis nie jest takie jak wszystkie inne”.