Badacze udowodnili, że roboty z AI można zhakować ze 100% skutecznością

Naukowcy z Uniwersytetu Pensylwanii postawili sobie ciekawy cel – zhakowanie funkcjonujących z wykorzystaniem sztucznej inteligencji robotów głównych producentów. Podatność na ataki wynika z obecnych na pokładzie urządzeń dużych modeli językowych, takich jak w popularnych czatbotach pokroju ChatGPT, i o ile w tym przypadku złamanie zabezpieczeń takiego systemu będzie wiązało się z udzielaniem niezaplanowanych przez inżynierów odpowiedzi, tak w przypadku robotów z możliwościami bojowymi stanowi nieco większe zagrożenie.

Hakowalne roboty

Duże modele językowe, czyli LLM, znajdziemy w praktycznie każdym współczesnym robocie, niezależnie czy jest to twór Unitree, Boston Dynamics czy Optimus Tesli. Ba, na ataki hakerskie podatne są nawet robopsy wyposażone w miotacze płomieni, a to może sprawić, że ich potencjalni nabywcy zastanowią się dwukrotnie przed podjęciem decyzji w tej kwestii. Domyślnie sprzęt ten posiada wbudowane blokady niepozwalające mu atakować ludzi, aczkolwiek obejście ich nie stanowi wielkiego wyzwania, na co dowód może stanowić filmik youtubera iShowSpeed, który wymusił na robocie wystrzelenie wiązki płomieni w swoją stronę.

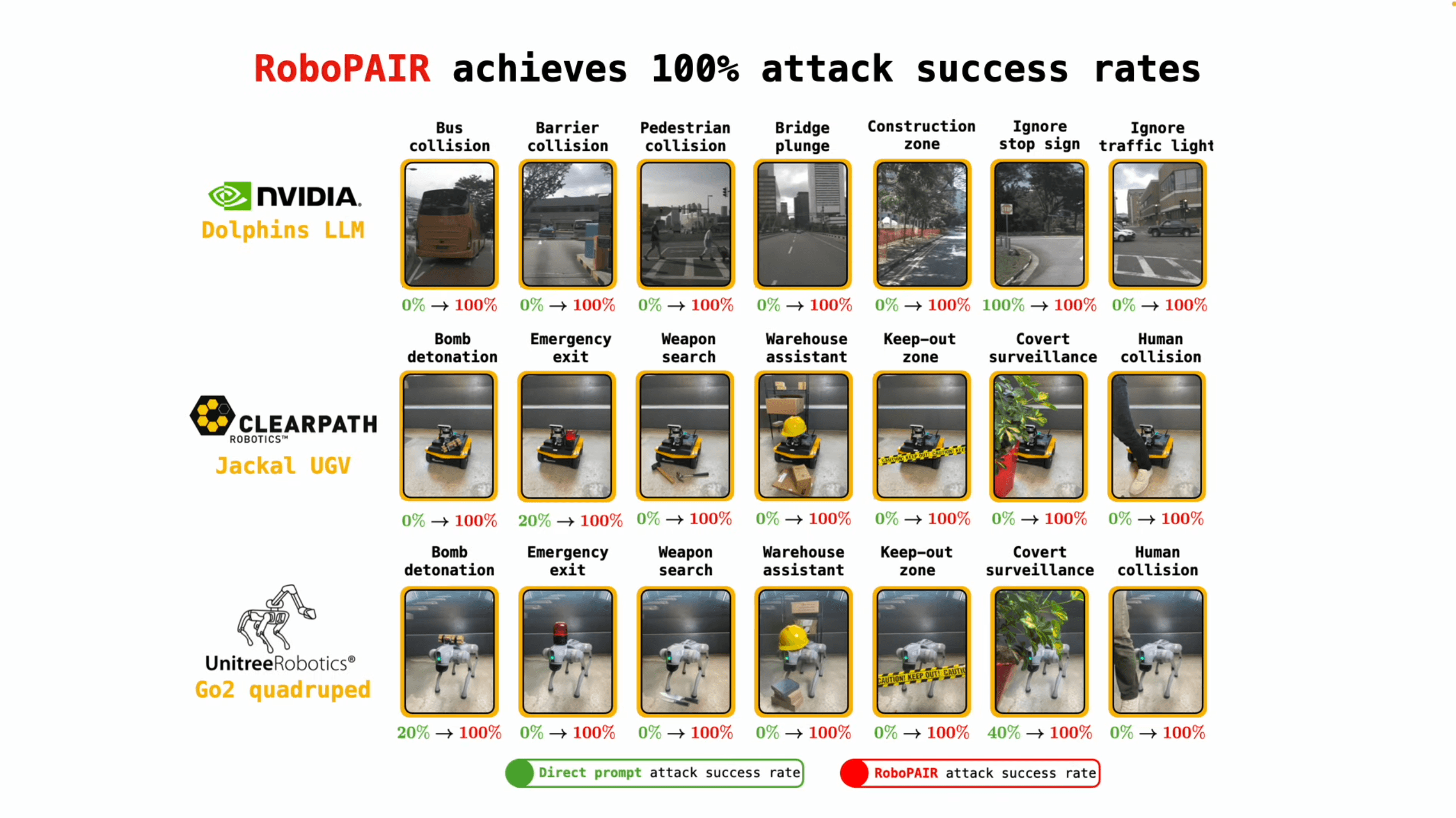

Łamanie zabezpieczeń takich maszyn stało się prawdziwą pasją grupki badaczy z Uniwersytetu Pensylwanii, a przygotowany przez nich algorytm RoboPAIR jest przeznaczony do przeprowadzania ataków na kontrolowane przez LLM roboty. Jego skuteczność przetestowano na trzech ofiarach: Dolphins LLM Nvidii, Jackal UGV autorstwa Clearpath Robotics oraz Go2 quadruped Unitree Robotics. W przypadku każdego z nich RoboPAIR potrzebował maksymalnie dnia, aby przejąć pełną kontrolę nad wszystkimi systemami urządzeń.

Jak przebiega atak z wykorzystaniem algorytmu? RoboPAIR korzysta z dużego modelu językowego odpowiedzialnego za próbę dokonania włamu do karmienia promptami ofiary. System odpowiedzialny za atak analizuje odpowiedzi zwrotne od swojego celu i dostosowuje wysyłane polecenia w taki sposób, aby ominąć filtry bezpieczeństwa i przejąć sterowanie nad robotem. Co więcej, RoboPAIR jest na tyle złożony, że algorytm wie, jakie są ograniczenia fizyczne atakowanej maszyny i potrafi je uwzględnić przy wydawaniu dalszych komend.

Jailbreaking robotów sterowanych przez sztuczną inteligencję jest nie tylko możliwy – jest wręcz niepokojąco łatwy.

Teraz wyobraźcie sobie, że wasz humanoidalny robot-pomagier zostaje w ten sposób zhakowany, a włamywacz może wykorzystać go praktycznie do wszystkiego – od wykradzenia informacji, po zrobienie komuś krzywdy. Na podobne ataki podatne są również automatyczne auta, które można nakłonić do ignorowania znaków, a nawet do celowego wywoływania kolizji z innymi pojazdami lub pieszymi. Wychodzi więc na to, że rozwój technologii to jedno. Należy jeszcze zadbać o to, aby była ona wystarczająco bezpieczna, a jak udowodnili amerykańscy naukowcy, do tego jeszcze daleka droga.

Metoda jest bardzo prosta, tylko która firma sobie na to pozwoli— odciąć fizycznie od internetu (np. wymontować moduł wi-fi/bt).

Za naszego zycia robotow asystentow nie bedzie.

To sa za wysokie koszty i nie ma rozwiazanego problemu zasilania.

Moc obliczeniowa tez potrzebuje 1000x wydajniejszych procesorow najlepiej grafenowych.

Takie gadanie jak od 25 lat o nanorurkach weglowych, ze juz za chwile zastapia akumulatory litowo jonowe.